Sora就这么泄露了三小时,网友调侃Altman急拔网线,艺术家们也在抗议被「白嫖」

Sora就这么泄露了三小时,网友调侃Altman急拔网线,艺术家们也在抗议被「白嫖」一觉醒来,挺突然的,Sora API 就这么泄露了。

一觉醒来,挺突然的,Sora API 就这么泄露了。

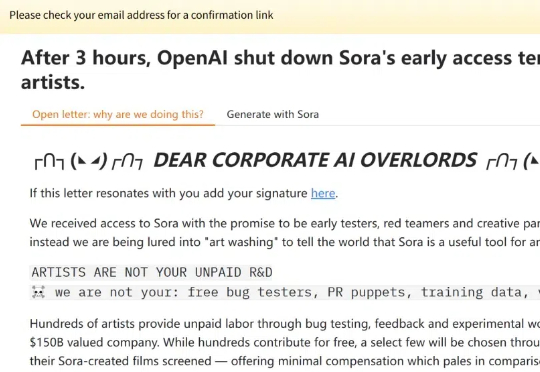

Sora 的发布让广大研究者及开发者深刻认识到基于 Transformer 架构扩散模型的巨大潜力。作为这一类的代表性工作,DiT 模型抛弃了传统的 U-Net 扩散架构,转而使用直筒型去噪模型。鉴于直筒型 DiT 在隐空间生成任务上效果出众,后续的一些工作如 PixArt、SD3 等等也都不约而同地使用了直筒型架构。

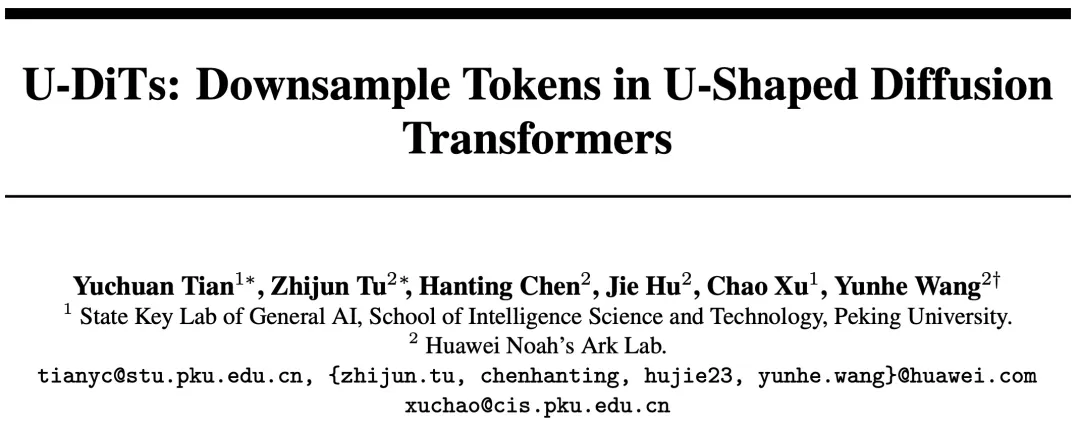

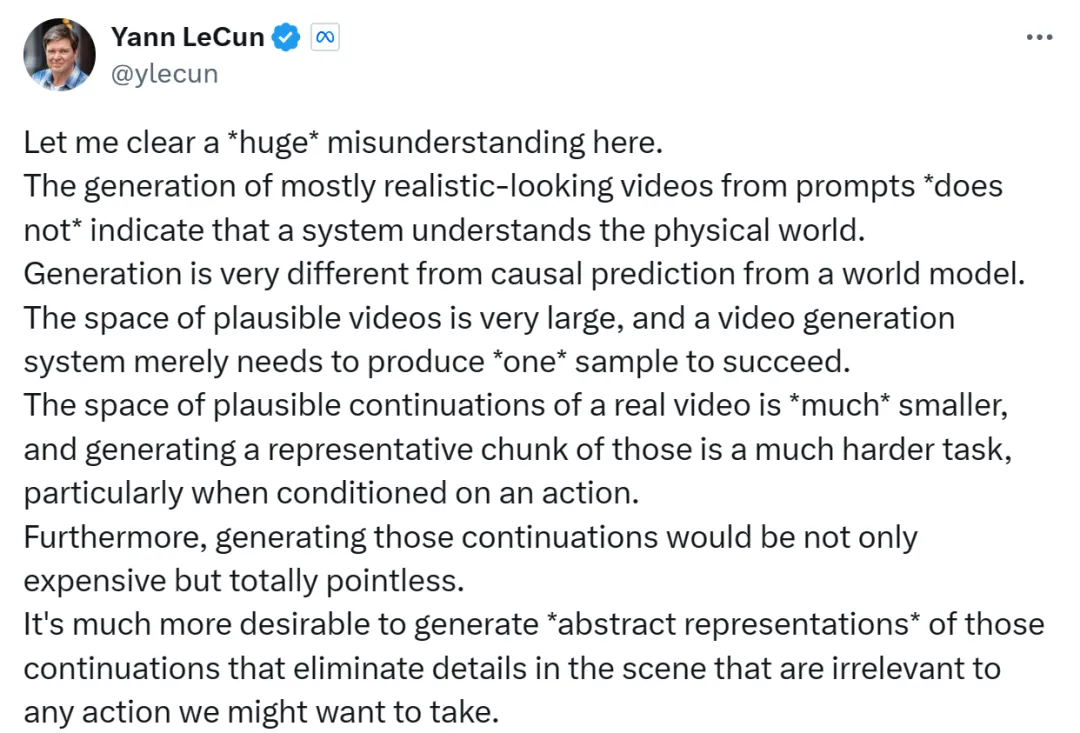

自从 Sora 横空出世,业界便掀起了一场「视频生成模型到底懂不懂物理规律」的争论。图灵奖得主 Yann LeCun 明确表示,基于文本提示生成的逼真视频并不代表模型真正理解了物理世界。之后更是直言,像 Sora 这样通过生成像素来建模世界的方式注定要失败。

10 月 31 日,以色列 AI 游戏视频生成公司 Decart 宣布获得红杉美国领投的 2100 万美元种子轮融资。

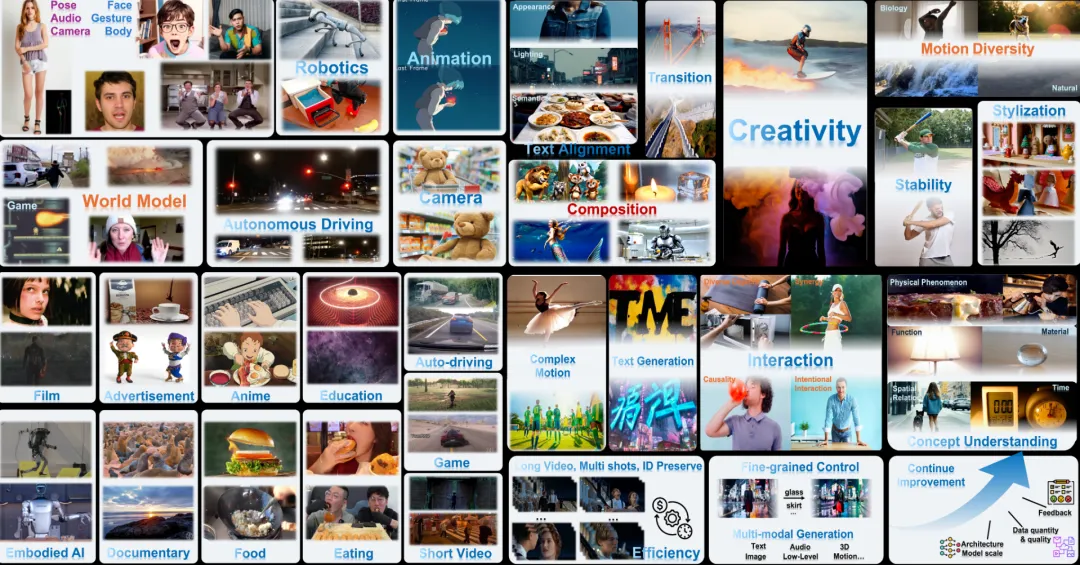

腾讯 AI Lab 联合中科大发布了一份针对类 SORA 视频生成模型的测评报告,重点聚焦目前最前沿的类 SORA DiT 架构的高质量视频生成闭源模型

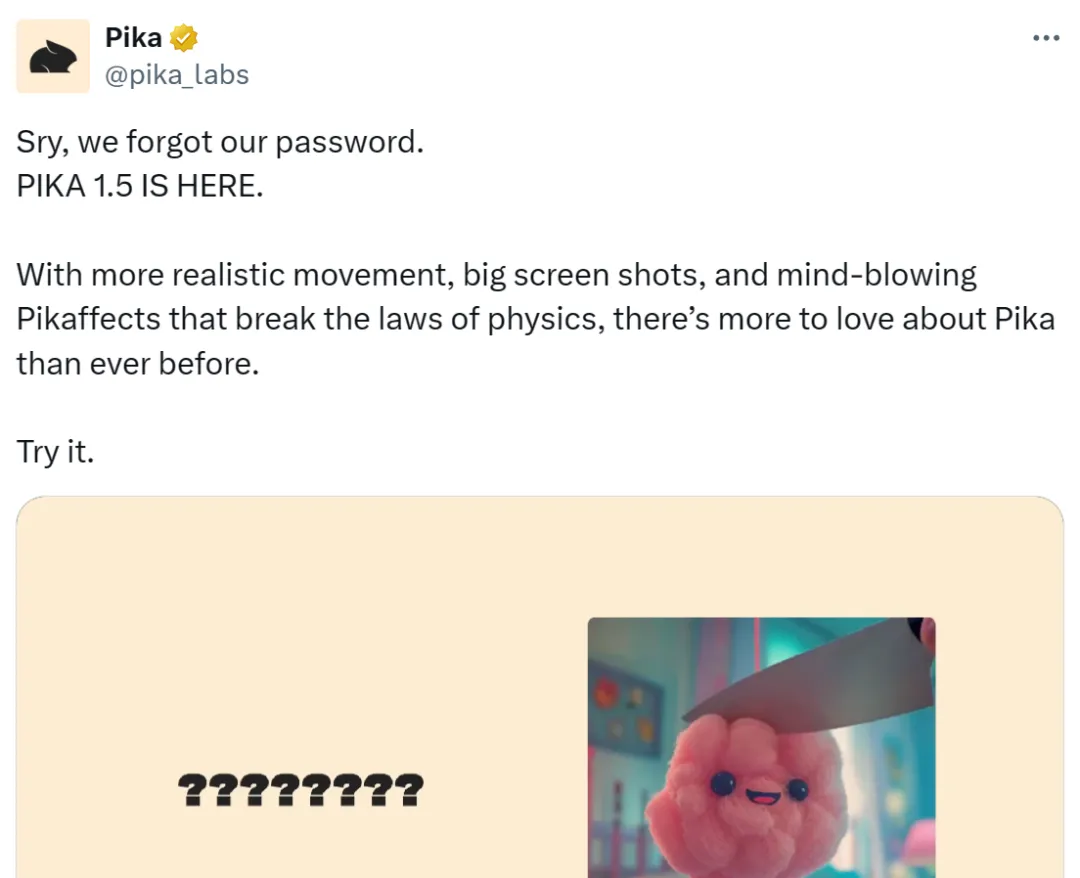

面对以 Sora 为代表的各种「后辈」视频生成模型的冲击,Pika 迟迟没有大的版本更新。

9月 24 日,字节跳动的豆包大模型发布多款新品——视频生成、音乐生成以及同声传译大模型。

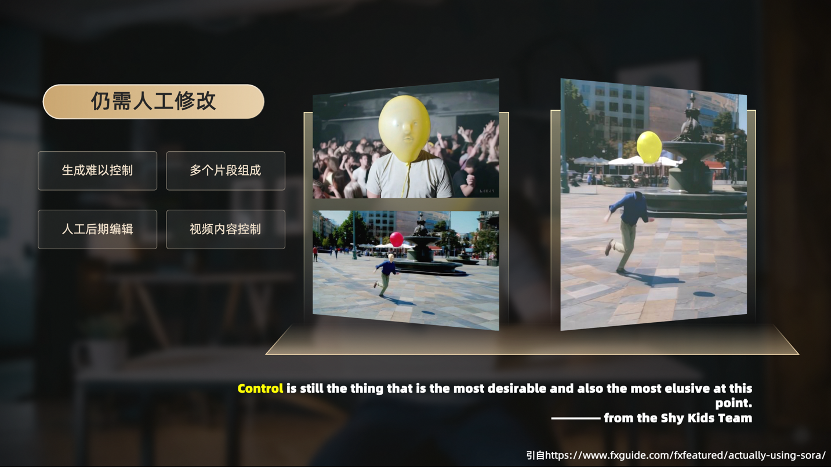

自从 Sora 发布以来,AI 视频生成领域变得更加「热闹」了起来。过去几个月,我们见证了即梦、Runway Gen-3、Luma AI、快手可灵轮番炸场。

OpenAI 在人工智能领域的领头羊地位家喻户晓。其产品聊天机器人 ChatGPT 系列、文生图 DALL・E 系列、文生视频 Sora 等都被誉为生产力提升的超强助手

今年是 AI 视频生成爆发的元年,以 Sora 为代表的算法模型和产品应用不断涌现。短短几个月内,我们目睹了几十种视频生成工具的问世,基于 AI 的视频创作方式开始流行起来。